In der schnelllebigen Welt der Informationstechnik wird die Leistungsfähigkeit eines Systems oft nur an der Taktfrequenz des Prozessors oder der Grafikleistung gemessen. Doch ein entscheidender Akteur im Hintergrund wird dabei häufig unterschätzt: der Arbeitsspeicher. Als zentrales Bindeglied zwischen dem Massenspeicher und der CPU bestimmt der RAM maßgeblich, wie flüssig sich ein System im Alltag anfühlt. Ob beim Öffnen hunderter Browser-Tabs, der Bearbeitung von 4K-Videomaterial oder dem Betrieb komplexer Datenbanken – der Arbeitsspeicher ist das Nadelöhr, durch das jede Information fließen muss. Ein Upgrade in diesem Bereich ist oft die effizienteste Methode, um ein System spürbar zu beschleunigen.

Die technologische Entwicklung hat mit dem Einzug von DDR5-Modulen eine neue Ära eingeläutet. Wir sprechen hier nicht mehr nur von einer schrittweisen Verbesserung, sondern von einer Verdopplung der Bandbreite im Vergleich zu älteren Standards. Moderne Speichermodule verfügen über integrierte Spannungsregler und Fehlerkorrekturmechanismen, die früher ausschließlich dem Server-Segment vorbehalten waren. Doch diese Power muss auch gebändigt werden. Damit ein System stabil läuft, müssen die Latenzzeiten und die Taktung perfekt auf den Chipsatz des Mainboards abgestimmt sein. Wer hier wahllos kombiniert, riskiert Systemabstürze oder verschenkt wertvolles Potenzial.

Besonders für Nutzer, die professionelle Workstations oder Server-Umgebungen betreuen, ist die Verlässlichkeit der Hardware das oberste Gebot. Hier geht es nicht nur um Megahertz-Zahlen, sondern um die Integrität der Daten. Fehlkäufe bei Billigherstellern rächen sich oft durch schleichende Datenkorruption oder unerklärliche Bluescreens. Ein tieferer Blick in die technischen Spezifikationen und die Wahl zertifizierter Module sind daher unumgänglich. Wer gezielt nach passenden Komponenten sucht, findet bei einem Experten für Arbeitsspeicher genau die Module, die für die jeweilige Architektur optimiert sind. Nur eine harmonische Abstimmung zwischen Speichercontroller und RAM-Riegel garantiert die maximale Performance.

Flaschenhälse eliminieren: Kapazität versus Geschwindigkeit

Oft stellt sich die Frage: Sollte man lieber in mehr Kapazität oder in eine höhere Taktrate investieren? Die Antwort hängt stark vom Anwendungsprofil ab. Während Gamer und Videocutter von niedrigen Latenzen und hohen Frequenzen profitieren, ist für Multitasking und Virtualisierung die schiere Menge an Gigabyte entscheidend. Wenn der physische Speicher voll ist, beginnt das Betriebssystem, Daten auf die SSD auszulagern. Selbst die schnellste NVMe-SSD ist jedoch um Größenordnungen langsamer als der RAM, was zu den bekannten „Rucklern“ führt. Ein gut dimensioniertes System sollte daher immer eine Reserve von mindestens 20 bis 30 Prozent für Lastspitzen bereithalten.

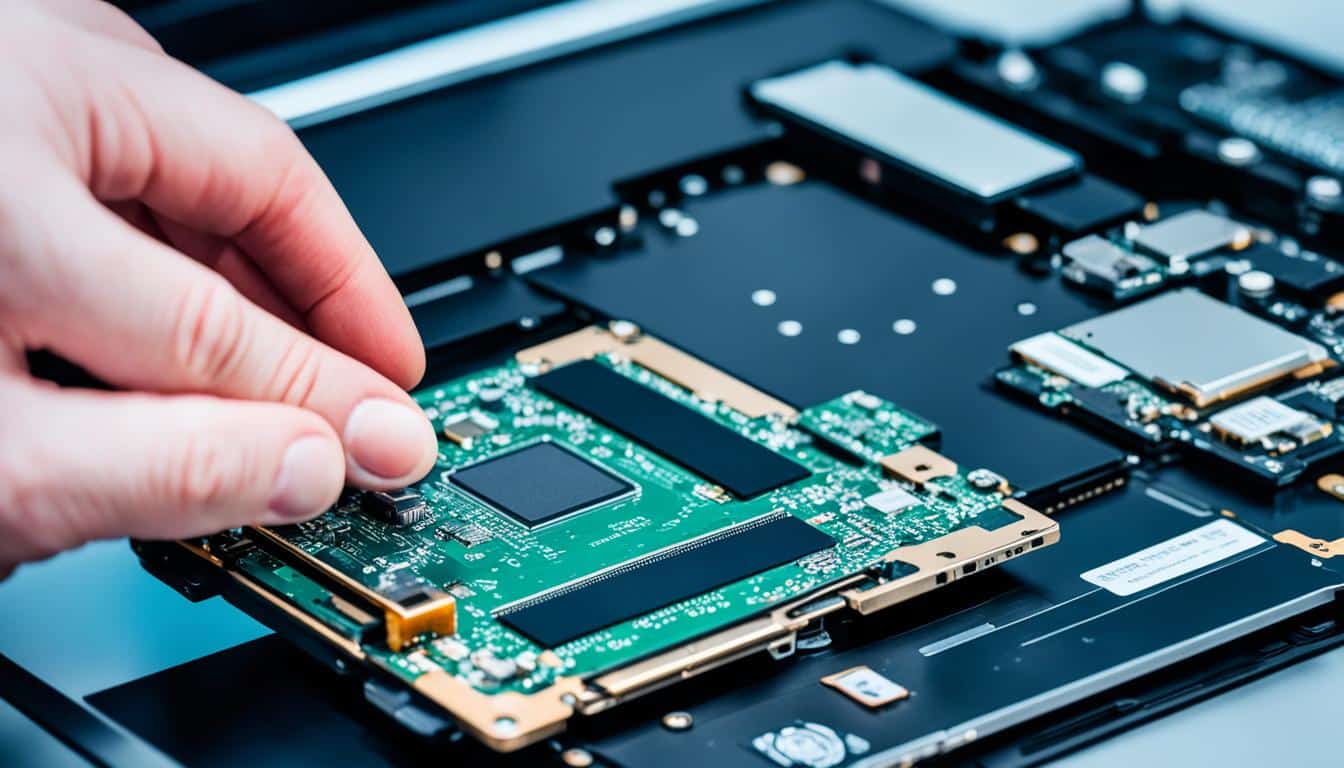

Ein technisches Detail, das oft übersehen wird, ist die Bestückung der Speicherbänke. Moderne Architekturen nutzen den sogenannten Dual-Channel- oder Quad-Channel-Modus. Das bedeutet, dass die Bandbreite vervielfacht wird, wenn zwei oder vier identische Module parallel betrieben werden. Wer nur einen einzelnen großen Riegel verbaut, halbiert theoretisch die mögliche Datentransferrate seiner CPU. Es ist daher ratsam, immer Kits aus zwei oder vier Modulen zu verwenden, die vom Hersteller bereits auf ihre Zusammenarbeit geprüft wurden. Diese technische Feinheit entscheidet oft darüber, ob ein High-End-Prozessor seine volle Leistung entfalten kann oder sprichwörtlich „auf dem Trockenen“ sitzt.

Zukunftssicherheit durch technologische Weitsicht

Mit dem Fortschreiten der künstlichen Intelligenz und lokaler Sprachmodelle steigen die Anforderungen an den Arbeitsspeicher weiter an. KI-Anwendungen laden riesige Parameter-Sätze direkt in den RAM, um schnelle Antwortzeiten zu ermöglichen. Wer heute einen PC oder Server plant, sollte daher die Skalierbarkeit im Auge behalten. Mainboards mit vier oder acht Slots bieten die Möglichkeit, später kostengünstig nachzurüsten. Dabei ist jedoch darauf zu achten, dass die maximale Taktrate bei Vollbestückung aller Slots oft leicht absinkt – ein physikalisches Phänomen, das durch die höhere Last auf dem Speicherbus entsteht.

Ein weiterer wichtiger Punkt ist die Kühlung. High-Performance-RAM entwickelt unter Last eine beträchtliche Abwärme. Hochwertige Aluminium-Heatspreader sind daher kein optisches Gimmick, sondern eine technische Notwendigkeit, um „Thermal Throttling“ – das Heruntertakten bei Hitze – zu verhindern. In kompakten Gehäusen oder dichten Server-Racks sollte zudem auf einen ausreichenden Luftstrom über die Speichermodule geachtet werden. Eine stabile Temperatur ist die Grundvoraussetzung für die Langlebigkeit der empfindlichen Halbleiterbausteine.

Zusammenfassend lässt sich sagen, dass der Arbeitsspeicher weit mehr ist als eine bloße Komponente auf einer Liste. Er ist der dynamische Spielraum, in dem sich Software entfalten kann. Wer die physikalischen Zusammenhänge von Taktung, Latenz und Kanalanbindung versteht, kann aus seiner Hardware deutlich mehr Leistung herausholen, als die Standardkonfiguration vermuten lässt. Qualität und Kompatibilität stehen dabei immer an erster Stelle, um aus einem schnellen PC ein absolut zuverlässiges Arbeitsgerät zu machen. In einer digitalen Welt, die niemals stillsteht, ist ein potenter Arbeitsspeicher die beste Versicherung gegen Produktivitätsverluste.